Ponarejanje digitalnih dokumentov se razrašča

3 min read

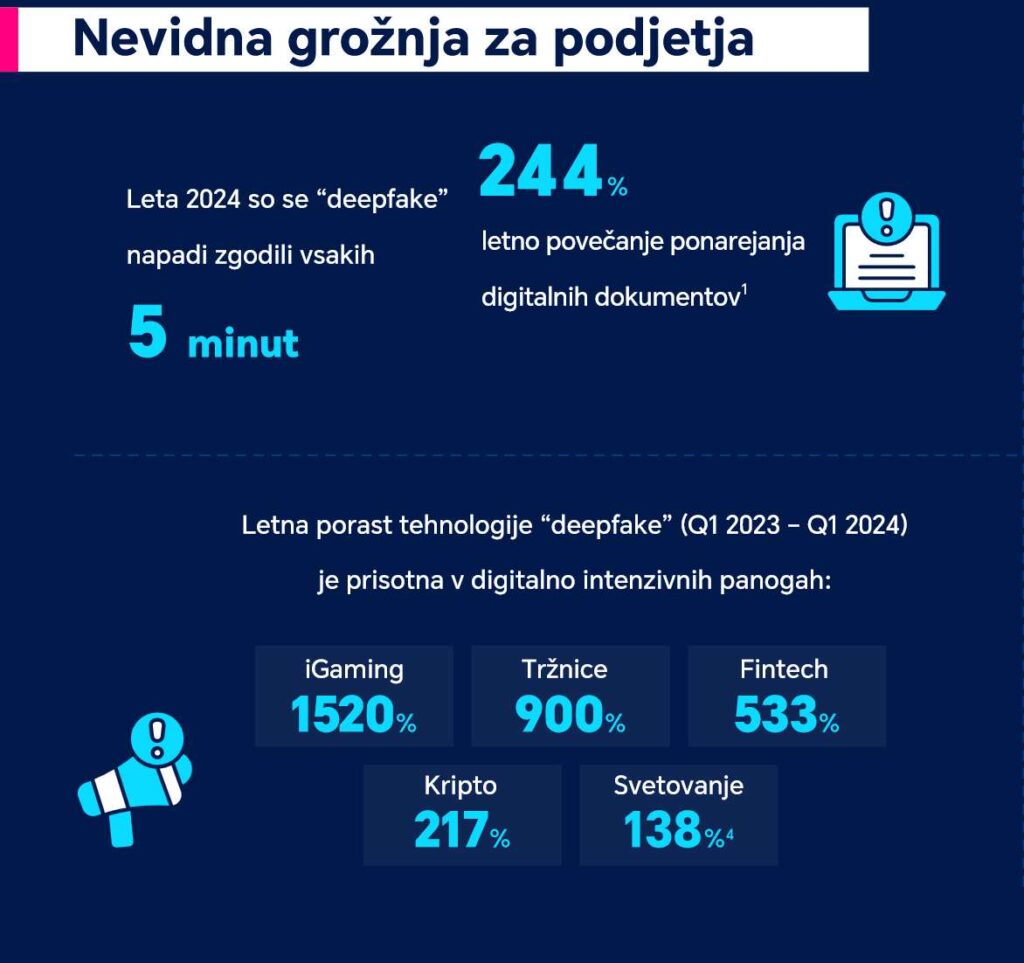

Napadi s tehnologijo “deepfake” postajajo vse bolj sofisticirani in pogostejši, kar povzroča veliko škodo tako zasebnim uporabnikom kot celotni industriji. Leta 2024 so se napadi z vsebinami “deepfake” dogajali vsakih pet minut, poročilo globalnega vodje na področju identitet, plačil in digitalne infrastrukture o prevarah z identitetami Entrust Cybersecurity Institut za leto 2025 pa razkriva, da je ponarejanje digitalnih dokumentov naraslo za kar 244 odstotkov na letni ravni. Še pred štirimi leti je bilo fizično ponarejanje dokumentov najpogostejša metoda goljufov.

Manipulirane slike, videoposnetki in zvočni posnetki postajajo vse težje prepoznavni, kar povečuje potrebo po nujnih zaščitnih ukrepih. Kot vodilna inovativna znamka, ki je osredotočena na uporabnika, je globalni tehnološki velikan HONOR sprejel proaktivne ukrepe za zaščito uporabnikov pred vse pogostejšimi grožnjami tehnologije “deepfake”. Na sejmu IFA 2024, največjem svetovnem sejmu potrošniške elektronike, ki je septembra potekal v Berlinu, je HONOR predstavil AI Deepfake Detection.

Gre za prvo tehnologijo na trgu, ki analizira subtilne nedoslednosti, pogosto nevidne človeškemu očesu, kot so sintetične nepravilnosti na ravni slikovnih pik, umetno spojeni robovi, neskladja med zaporednimi kadri ter nesimetrija pričeske in obraznih potez v razmerju do ušes. Če sistem zazna manipulirano vsebino, uporabnik prejme takojšnje opozorilo in se tako zaščiti pred morebitnimi tveganji, povezanimi z vsebinami “deepfake”. Prva funkcija UI za prepoznavanje vsebin “deepfake”, ki jo je razvil HONOR, bo globalno dostopna od aprila letos.

»Uporaba UI za prepoznavanje vsebin “deepfake” na mobilnih napravah je močno orodje v boju proti tehnologiji “deepfake”. Ta funkcija lahko prepozna nepravilnosti, ki jih človeško oko morda ne bi opazilo, kot so očesni stik, osvetlitev, jasnost slike in reprodukcija videoposnetkov. Tako uporabnike odvrača od nadaljnje interakcije s potencialno nevarnimi vsebinami, ki bi lahko ogrozile njihovo varnost. To omogoča posameznikom, malim in srednje velikim podjetjem ter industrijam, da brez skrbi uživajo v prednostih digitalne komunikacije, ne da bi jih skrbelo uhajanje zasebnih podatkov ali tveganje prevar,« je povedal Marco Kamiya, predstavnik Organizacije združenih narodov za industrijski razvoj.

Nujnost takšnih inovativnih tehnologij potrjuje tudi Deloitteovo poročilo za leto 2024 o povezanosti potrošnikov, v katerem je 59 odstotkov vprašanih priznalo, da težko ločijo vsebine, ki jih ustvarijo ljudje, od tistih, ki jih generira umetna inteligenca. Poleg tega se je 84 odstotkov vprašanih, ki poznajo generativno umetno inteligenco, strinjalo, da morajo biti vsebine, ustvarjene s pomočjo generativne UI, vedno jasno označene.

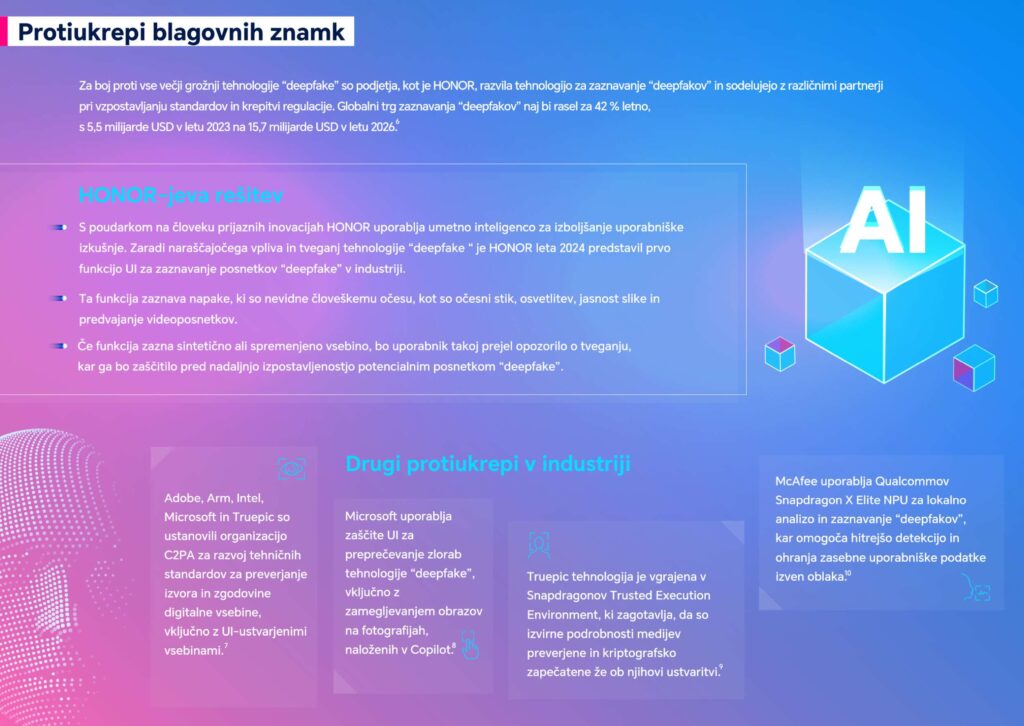

Strokovnjaki iz industrije se s tem strinjajo, organizacije, kot je Content Provenance and Authenticity (C2PA), pa razvijajo tehnične standarde za certificiranje virov in zgodovine digitalnih vsebin – vključno z materiali, ki so ustvarjeni z umetno inteligenco. C2PA je mednarodna organizacija, ki se osredotoča na zagotavljanje avtentičnosti in sledljivosti digitalnih vsebin, kar vključuje tudi razvijanje rešitev za preprečevanje manipulacij in ponarejanj. Zlasti v svetu, kjer so vsebine vse pogosteje ustvarjene z uporabo naprednih tehnologij, kot je umetna inteligenca.

Podatki kažejo, da bo globalni trg za prepoznavanje vsebin deepfake rasel za 42 odstotkov letno – s 5,5 milijarde USD v letu 2023 na 15,7 milijarde USD v letu 2026.